Deepfake và lời cảnh tỉnh xã hội

Trí tuệ nhân tạo (AI) đã được sử dụng trong các cuộc bầu cử ở Slovakia, Đài Loan (Trung Quốc) và Indonesia, và đặc biệt đang gây rắc rối trong cuộc đua bầu cử quan trọng hiện nay tại Mỹ khi nó bị lợi dụng để tạo ra các nội dung đánh lừa cử tri. Điều đáng lo ngại hơn cả là những tác phẩm giả mạo được sản xuất bằng AI này đang hoành hành trong một môi trường mà niềm tin vào các chính trị gia, tổ chức và giới truyền thông vốn đã thấp.

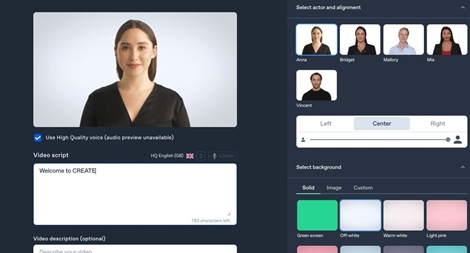

Khi các tác phẩm deepfake do AI tạo ra đang được sử dụng để truyền bá thông tin sai lệch trong các cuộc bầu cử trên khắp thế giới, các nhà hoạch định chính sách, công ty công nghệ và chính phủ đang cố gắng bắt kịp và xử lý các mối đe dọa này.

Lời cảnh tỉnh đối với các nhà lập pháp, các công ty AI và các mạng xã hội

Những hình ảnh bịa đặt lan truyền trên mạng thời gian gần đây xung quanh cuộc bầu cử tổng thống Mỹ sẽ diễn ra vào tháng 11 tới, trong đó có hình ảnh cựu Tổng thống Donald Trump được bao quanh bởi các nhóm người da đen đang mỉm cười và nô đùa, như thể ông Trump đang tìm cách thu phục cử tri da đen, những người mà các cuộc thăm dò cho thấy vẫn trung thành với Tổng thống Joe Biden, là những bằng chứng củng cố những cảnh báo rằng việc sử dụng hình ảnh do AI tạo ra sẽ chỉ gia tăng khi cuộc tổng tuyển cử tháng 11 đến gần.

Các chuyên gia cho biết điều này đang nhấn mạnh một mối nguy hiểm là bất kỳ nhóm cử tri nào - người Latin, phụ nữ, cử tri nam lớn tuổi… đều có thể trở thành mục tiêu của những hình ảnh sống động như thật nhằm đánh lừa và gây nhầm lẫn cũng như thể hiện sự cần thiết phải có quy định về công nghệ.

Trong một báo cáo vừa được công bố, các nhà nghiên cứu tại Trung tâm Phi lợi nhuận Chống lại sự thù hận trên không gian mạng (Mỹ) đã sử dụng một số chương trình AI phổ biến để cho thấy việc tạo ra các tác phẩm sử dụng công nghệ deepfake có thể đánh lừa cử tri dễ dàng như thế nào. Các nhà nghiên cứu đã có thể tạo ra hình ảnh ông Trump gặp gỡ các đặc vụ Nga, ông Biden "nhồi" thùng phiếu và các thành viên dân quân có vũ trang tại các địa điểm bỏ phiếu, mặc dù nhiều chương trình AI cho biết họ có quy định cấm loại nội dung này.

Trung tâm này đã phân tích một số hình ảnh deepfake gần đây về ông Trump và cử tri da đen và xác định rằng ít nhất một video ban đầu được tạo ra nhằm mục đích châm biếm nhưng hiện đang được những người ủng hộ ông Trump chia sẻ như một bằng chứng về sự ủng hộ của ông đối với người da đen. Imran Ahmed, Giám đốc điều hành và người sáng lập của trung tâm, cho biết các nền tảng truyền thông xã hội và các công ty AI phải làm nhiều hơn nữa để bảo vệ người dùng khỏi những tác động có hại của AI. Ahmed nói: “Nếu một bức ảnh đáng giá cả nghìn lời nói, thì những công cụ tạo hình ảnh dễ gây ảnh hưởng một cách nguy hiểm này, cùng với những nỗ lực kiểm duyệt nội dung ảm đạm của phương tiện truyền thông xã hội chính thống, trở thành một công cụ mạnh mẽ để những kẻ xấu đánh lừa cử tri như chúng ta đã thấy. Đây là lời cảnh tỉnh cho các công ty AI, nền tảng truyền thông xã hội và các nhà lập pháp: Hãy hành động ngay, nếu không sẽ khiến nền dân chủ Mỹ gặp rủi ro”.

Các chuyên gia dự báo những nỗ lực bổ sung để sử dụng các tác phẩm deepfake do AI tạo ra để nhắm mục tiêu vào các khối cử tri cụ thể ở các bang xung đột quan trọng, chẳng hạn như người Latin, phụ nữ, người Mỹ gốc Á và những người bảo thủ lớn tuổi hoặc bất kỳ nhóm nhân khẩu học nào khác mà chiến dịch hy vọng sẽ thu hút, sẽ đánh lừa hoặc gây sợ hãi. Trong bối cảnh có hàng chục quốc gia tổ chức bầu cử trong năm nay, những thách thức do deepfake đặt ra là một vấn đề toàn cầu.

Vào tháng 1, các cử tri ở New Hampshire đã nhận được một cuộc gọi tự động bắt chước giọng nói của ông Biden, đánh lừa họ rằng nếu họ bỏ phiếu trong cuộc bầu cử sơ bộ ở bang đó thì họ sẽ không đủ điều kiện để bỏ phiếu trong cuộc tổng tuyển cử. Một nhà tư vấn chính trị sau đó đã thừa nhận việc tạo ra cuộc gọi tự động, đây có thể là nỗ lực đầu tiên được biết đến nhằm sử dụng AI để can thiệp vào cuộc bầu cử ở Mỹ.

Theo một nghiên cứu hồi tháng 2 của các nhà nghiên cứu tại Đại học Stanford về tác động tiềm tàng của AI đối với cộng đồng người da đen, nội dung như vậy có thể có tác động mang tính phá hủy ngay cả khi nó không được tin tưởng. Khi mọi người nhận ra rằng họ không thể tin tưởng vào những hình ảnh họ nhìn thấy trên mạng, họ có thể bắt đầu đánh giá thấp cả những nguồn thông tin hợp pháp. Các nhà nghiên cứu viết: “Khi nội dung do AI tạo ra trở nên phổ biến hơn và khó phân biệt với nội dung thật do con người tạo ra, các cá nhân có thể trở nên hoài nghi và không tin tưởng hơn vào thông tin họ nhận được”.

Ngay cả khi nó không thành công trong việc đánh lừa một số lượng lớn cử tri, nội dung do AI tạo ra về bỏ phiếu, ứng cử viên và bầu cử có thể khiến bất kỳ ai cũng khó phân biệt sự thật với hư cấu, khiến họ đánh giá thấp các nguồn thông tin hợp pháp và gây nhiễu thông tin, làm xói mòn niềm tin vào nền dân chủ đồng thời làm gia tăng sự chia rẽ chính trị.

Mặc dù những tuyên bố sai sự thật về ứng cử viên và cuộc bầu cử là không có gì mới, nhưng AI giúp việc tạo ra hình ảnh, video và âm thanh sống động như thật nhanh hơn, rẻ hơn và dễ dàng hơn bao giờ hết. Khi được phát hành trên các nền tảng truyền thông xã hội như TikTok, Facebook hoặc X, các tác phẩm deepfake bằng AI có thể tiếp cận hàng triệu người, thậm chí trước cả khi các công ty công nghệ, quan chức chính phủ hoặc các cơ quan báo chí hợp pháp biết đến sự tồn tại của chúng.

Nỗ lực phối hợp của các bên

Hồi giữa tháng 2, tại Hội nghị an ninh Munich, các công ty công nghệ lớn đã thực hiện một bước tiến lớn trong việc phối hợp nỗ lực của họ bằng việc ký kết thỏa thuận tự nguyện áp dụng “các biện pháp phòng ngừa hợp lý” nhằm ngăn chặn việc AI bị sử dụng để phá hoại các cuộc bầu cử dân chủ trên toàn thế giới.

Trong số các bên ký kết có OpenAI, nhà sáng tạo ChatGPT, cũng như Google, Adobe và Microsoft... tất cả đã tung ra các công cụ để tạo nội dung do AI tạo ra. Nhiều công ty cũng đã cập nhật các quy tắc riêng của họ và cấm sử dụng sản phẩm của họ trong các chiến dịch có màu sắc chính trị. Nhưng việc thực thi những lệnh cấm này lại là một vấn đề khác.

Phần mềm Dall-E của Open AI, được sử dụng mạnh mẽ để tạo ra hình ảnh chân thực, cho biết công cụ của họ sẽ từ chối các yêu cầu tạo hình ảnh của người thật, bao gồm cả các ứng cử viên.

Midjourney - công cụ tạo hình ảnh AI được nhiều người cho là mạnh mẽ và chính xác nhất - cho biết người dùng không được sử dụng sản phẩm này cho các chiến dịch chính trị “hoặc cố gắng gây ảnh hưởng đến kết quả của một cuộc bầu cử”.

Giám đốc điều hành của Midjourney, ông David Holz cho biết công ty sắp cấm các hình ảnh chính trị, bao gồm cả hình ảnh của các ứng cử viên tổng thống hàng đầu. Một số thay đổi dường như đã có hiệu lực. Khi Guardian yêu cầu Midjourney tạo hình ảnh ông Joe Biden và ông Donald Trump trên võ đài quyền Anh, yêu cầu này đã bị từ chối và bị gắn mác là vi phạm các tiêu chuẩn cộng đồng của công ty.

Trong khi đó, Joe Paul nhấn mạnh thêm rằng kiến thức kỹ thuật số và kỹ năng tư duy phản biện là một trong những biện pháp bảo vệ chống lại thông tin sai lệch do AI tạo ra. Ông nói: “Mục tiêu là trao quyền cho mọi người đánh giá nghiêm túc thông tin họ tiếp cận được trên mạng. Khả năng tư duy phản biện là một nghệ thuật đã bị thất truyền trong tất cả các cộng đồng, chứ không chỉ cộng đồng da màu”.

Liệu đã quá muộn?

Không chỉ Mỹ, EU cũng sắp thông qua một trong những luật toàn diện nhất để quản lý AI, nhưng phải đến năm 2026 thì luật này mới có hiệu lực. Quy định được đề xuất ở Anh cũng đã bị chỉ trích vì tiến triển quá chậm.

Và bất chấp lệnh cấm sử dụng các công cụ của Open AI trong chiến dịch chính trị, Reuters đưa tin rằng các sản phẩm của họ đã được sử dụng rộng rãi trong cuộc bầu cử ở Indonesia - để tạo ra tác phẩm nghệ thuật cho chiến dịch, theo dõi cảm xúc trên mạng xã hội, xây dựng chatbot tương tác và nhắm mục tiêu đến cử tri.

Katie Harbath, chuyên gia từng làm việc tại bộ phận chính sách của Facebook và hiện đang nghiên cứu về sự giao thoa giữa công nghệ và dân chủ, cho biết đây là một câu hỏi mở về cách các công ty mới hơn như OpenAI có thể chủ động thực thi chính sách của họ bên ngoài Mỹ: “Mỗi quốc gia đều có một chút khác biệt, với luật pháp và chuẩn mực văn hóa khác nhau… Khi bạn tập trung vào Mỹ, thật khó để nhận ra rằng cách mọi thứ hoạt động ở Mỹ không giống như cách mọi thứ đang vận hành ở những nơi khác”.

Cuộc bầu cử quốc gia ở Slovakia năm ngoái đã chứng kiến màn đọ sức giữa một ứng cử viên thân Nga với một ứng cử viên khác ủng hộ việc duy trì mối quan hệ chặt chẽ hơn với EU.

Trước cuộc bỏ phiếu, giám đốc kỹ thuật số của EU Vera Jourova cho biết cuộc bầu cử ở Slovakia sẽ là một phép thử về mức độ dễ bị tổn thương của các cuộc bầu cử ở châu Âu trước cái mà các quan chức EU gọi là “vũ khí thao túng hàng triệu euro” được sử dụng để can thiệp vào các cuộc bầu cử.

Khi cuộc bầu cử đến gần và phương tiện truyền thông quốc gia bắt đầu im lặng, một đoạn ghi âm của ứng cử viên thân EU, Michal Simecka, đã được đăng lên Facebook.

Trong đoạn ghi âm, Simecka dường như đang thảo luận về kế hoạch gian lận cuộc bầu cử bằng cách mua phiếu bầu từ các cộng đồng bị thiệt thòi. Âm thanh là giả - và hãng tin AFP cho biết nó có dấu hiệu bị thao túng bằng cách sử dụng AI.

Tuy nhiên, với việc các cơ quan truyền thông và các chính trị gia được yêu cầu giữ im lặng theo luật cấm bầu cử (trong vòng 48 giờ trước khi các hòm phiếu được mở ra), việc vạch trần đoạn ghi âm gần như là không thể.

Âm thanh bị thao túng dường như đã lọt vào kẽ hở trong cách chủ sở hữu Facebook, Meta, quản lý tài liệu do AI tạo ra trên nền tảng của nó. Theo tiêu chuẩn cộng đồng của mình, việc đăng nội dung đã bị thao túng theo những cách “không rõ ràng đối với một người bình thường” và trong đó một người đã được chỉnh sửa để nói “những lời mà họ không nói” đều bị cấm. Sau khi chứng kiến những điều được cho là hậu quả tiêu cực từ AI này, các quốc gia trên thế giới sẽ nghiền ngẫm những gì đã xảy ra ở Slovakia để tìm manh mối về những thách thức mà họ cũng có thể gặp phải: Đó là láng giềng Ba Lan, nơi mà một nghiên cứu gần đây của EU cho rằng đặc biệt có nguy cơ trở thành mục tiêu của thông tin sai lệch, sẽ tiến hành bỏ phiếu sau đó 2 tuần, đó sẽ là Anh, Ấn Độ, Mỹ và cả EU với những cuộc bầu cử trong năm 2024.

Đối với nhiều chuyên gia, lĩnh vực quan tâm chính không phải là công nghệ mà chúng ta đang phải đối mặt mà là những đổi mới ở phía bên kia đường chân trời. Các học giả viết trên Tạp chí Công nghệ của MIT cho rằng khi nói đến việc AI có thể đe dọa nền dân chủ của chúng ta như thế nào, các cuộc thảo luận đang “thiếu trí tưởng tượng”. Mối nguy hiểm thực sự không phải là điều chúng ta đã sợ hãi mà là điều chúng ta chưa thể tưởng tượng được.

Harbath đặt câu hỏi: “Những tảng đá mà chúng ta không nhìn thấy là gì? Công nghệ mới xuất hiện, những kẻ xấu mới xuất hiện. Môi trường hiện nay đang chứng kiến một sự biến động liên tục mà chúng ta cần phải làm quen với việc sống trong đó”.

Chuyên gia Paul kết luận rằng kiến thức kỹ thuật số và kỹ năng tư duy phản biện là một trong những biện pháp bảo vệ chống lại thông tin sai lệch do AI tạo ra. Ông nói: “Mục tiêu là trao quyền cho mọi người đánh giá nghiêm túc thông tin họ tiếp cận được trên mạng. Khả năng tư duy phản biện là một nghệ thuật đã bị thất truyền trong tất cả các cộng đồng, chứ không chỉ cộng đồng da đen”.

Hai mặt của công nghệ Deepfake

Hai mặt của công nghệ Deepfake  Cuộc chiến chống lại “DEEPFAKES”

Cuộc chiến chống lại “DEEPFAKES”